가짜뉴스를 이해하고 대응 방안을 수립하기 위해서는 먼저 명확한 정의가 필요하다. 노스이스턴 대학교의 '데이비드 라자(David Lazer)' 교수는 '기존 언론에서 생산하는 콘텐츠 형식을 모방한 조작된 정보'라고 가짜뉴스를 정의한다. '데이비드 라자'의 정의는 가짜뉴스가 진실된 언론의 형식을 차용하지만, 실제 언론이 추구하는 보도의 정확성이나 정보의 신뢰도, 편집 윤리가 결핍되어 있음에 주목했다. 또한 그는 가짜뉴스를 '실수에 의한 정보(Mis-information)', '의도적으로 생성된 거짓 정보(Dis-infirmation)'를 비롯한 모든 '정보 장애(information disorder)'를 포함하는 것으로 정의했다. 여기에서도 이와 같은 정의를 따르기로 하자.

0. 목차

- 가짜뉴스는 왜 확산되는가?

- 트위터는 확산하기 쉬운 SNS

- 가짜뉴스의 패턴

- 가짜뉴스 확산에 대처하는 두 가지 접근법

- 확산되는 화제에 이끌리는 심리

- 각국의 가짜뉴스 대응 사례

- 가짜뉴스의 미래

1. 가짜뉴스는 왜 확산되는가?

'소셜미디어(Social Media)'는 누구나 뉴스 생성에 기여할 수 있어 발 빠르게 현장 소식을 전할 수 있다. 하지만 정보의 검열과 통제가 부재하기 때문에, 가짜뉴스가 빠르게 퍼질 수 있다. 이러한 확산은 관심을 받는 기사를 좋은 콘텐츠로 인식하는 '플랫폼의 특성'과 확증편향에 따라 정보를 소비하는 '사용자의 특성'에 기인한다.

1-1. 관심을 받는 기사를 좋은 콘텐츠로 인식하는 '플랫폼'

먼저 플랫폼은 다양한 정보 중에서 사람들의 관심을 받는 기사를 알고리즘으로 자동 선출하여 재확산시킨다. 사용자들이 클릭을 많이 한 기사는 사실 여부와 상관없이 플랫폼에 의해 '좋은 콘텐츠'로 인식된다. 그 결과, 자극적인 내용으로 선택을 맡은 기사라 하더라고 상위로 노출되어 재확산시킨다. '구글(Google)'의 경우도 알고리즘에 의해 검색 결과 상위에 가짜뉴스가 올라오는 문제가 제기되었다. 2016년 미국 대선 직후, 구글 검색창에서 'Final election vote count 2016(결선 투표 결과 2016)'이라는 검색어를 입력하면, '70 뉴스(70 News)'라는 가짜뉴스 사이트의 기사가 검색 순위 최상단에 올라왔다. 해당 기사 내용은 '도널드 트럼프(Donald Trump, 1946~)'가 '클린턴을 상대로 '힐러리 로댐 클린턴(Hillary Rodham Clinton, 1947~)'를 상대로 '선거인단 및 일반인 투표' 모두에서 이겼다는 것이다. 물론 이는 가짜뉴스다.

1-2. 확증편향에 따라 정보를 소비하는 '사용자'

다음으로 소셜미디어 사용자들은 기사의 헤드라인, 사진, 리드 등을 토대로 빠르고 함축적인 정보 소비를 한다. 소셜미디어를 통해 접하는 정보 대부분은 요약된 형태로만 소비될 뿐, 실제 뉴스 전문을 클릭해 보지 않기 때문에, 뉴스의 제공자가 누구인지, 인용된 사진의 출처가 확실한지, 헤드라인과 뉴스 전문이 일치하는지 검증하지 않는다. 이러한 환경에서는 자극적인 헤드라인이나 낚시성 기사가 확산되기 쉽다.

또 소셜미디어의 정보 소비는 자신과 신념이 일치하는 생각이나 글만 선택적으로 찾고 재확산시키는 '확증편향(Confirmation bias)'을 가속화시킨다. 소셜미디어에서 관심사가 비슷한 사람과 네트워크를 맺고 유사한 정보를 공유함으로써, 확증편향에 따라 자신들이 갖고 있던 신념을 강화하는 방향으로만 정보들을 공유하기 시작하는 '필터 버블(Filter Bubble)'이 형성된다. 그 결과, 소셜미디어는 가짜뉴스 전파를 위한 최적의 환경이 된다.

2. 트위터는 확산하기 쉬운 SNS

현재 세계적으로 다양한 SNS가 제공되고 있다. 전 세계적으로 이용자가 많은 SNS로는 '페이스북(FaceBook)', '트위터(Twitter)', '인스타그램(Instagram)' 등을 들 수 있다. 그중에서도 트위터는 확산이라는 현상이 일어나기 쉬운 SNS이다. 트위터는 비교적 짧은 문장에 이따금 사진이나 동영상을 첨부해 올리는 SNS이다. 누군가가 올린 '트윗(Tweet)'에 대해, 팔로워들은 자동으로 트윗을 전달받을 수 있고 손쉽게 공유하거나 인용할 수 있는 기능이 있다. 또 이용자가 비공개로 설정하지 않는 한, 이용자가 올린 내용은 기본적으로 공개되어 누구든 볼 수 있다. 따라서 원래는 그다지 주목할 만한 글이 아니어도 많은 팔로워를 지닌 사람이 주목해 리트윗하면 인터넷상에서 갑자기 정보가 확산되기도 한다. 일반적으로 업로드한 글에 보통과는 달리 많은 리트윗이 있는 경우 확산되었다고 한다. 리트윗은 얼마나 확산되었는지를 판단하는 하나의 기준이 된다.

2-1. 트위터 이용자의 80%는 '미포머'

2009년, 미국 라트거스 대학교의 연구자가 실시한 조사에 따르면, 트위터 이용자는 크게 '인포머(informer)'와 '미포머(Meformer)' 두 부류로 나눌 수 있다고 한다.

- 인포머(informer): '인포머'는 주로 '정보(information)'을 올리는 사람들이다. '이런 뉴스가 있다.', '이런 신상품이 개발되었다' 등 정보원을 밝히면서 올린다. 트위터상에서 연결되어 있는 사람 수도 비교적 많으며, 그들과 다양한 정보를 공유하는 행동을 취하는 경우가 많다.

- 미포머(Meformer): '미포머'는 주로 자신과 관련된 이야기를 올리는 사람들이다. '이 레스토랑의 요리가 맛있어요!', '업무를 끝내니 피곤하다' 등 자기 자신의 행동과 체험, 감정을 매일 올린다. 관심 있는 뉴스나 동영상을 올리는 경우에도 그 뉴스와 동영상을 보고 자신이 어떻게 느꼈는지를 주로 올린다.

조사 결과에 따르면, 트위터에서 인포머와 미포머의 비율은 약 2:8이었다고 한다. 결국 트위터 이용자의 약 80%는 미포머인 셈이다. 트위터 이용자 대부분이 '미포머'라는 사실은 현대에 어떤 화제가 확산되기 쉬운지와 큰 관련이 있다. SNS에서는 정보 그 자체보다 체험과 감정을 동반한 투고가 더 많이 공유되는 경향이 있다. '미포머'가 사회에 중요해서가 아니라, 자신에게 중요하다고 느낀 점을 공유하는 경향을 지니기 때문이다.

2-2. 내용을 믿지 않아도 헛소문은 퍼진다.

SNS에서 정보 특히 소문과 헛소문을 확산하는 사람들의 심리는 무엇일까?

2020년 1월, 각국에서 코로나19 감염자가 확인된 후, 오스트레일리아에서는 3월 화장지 사재기가 극성을 부렸다. 사람들은 트위터를 비롯한 SNS에 텅텅 빈 화장지 매대 사진을 올렸고, 화장지를 제조할 때 필요한 재료가 마스크 제조에 사용돼 화장지를 만들 수 없는 때가 곧 올 것이라는 가짜뉴스가 일파만파 퍼지면서, 사람들의 사재기 심리를 부추겼다. 정부는 화장지가 부족할 일은 없을 거라 강조했지만, 소셜미디어와 뉴스에 자극을 받은 사람들은 사재기를 쉽게 멈추지 않았다.

이런 헛소문이 급격하게 퍼진 배경에는 자신의 체험과 기분을 공유하고 싶은 미포머의 존재가 큰 영향을 미친 것으로 보인다. 미포머는 화장지가 부족하다는 정보는 헛소문임을 알고 있으면서 '화장지가 부족하다는 헛소문이 퍼지고 있다는 것을 듣고 불안해졌다.'는 기분을 SNS에 올린다. 그러면 트위터 이용자의 80%를 차지하는 미포머 사이에서 '헛소문을 듣고 불안해졌다'는 체험이 널리 공유된다. 그리고 '자신은 헛소문을 믿지 않지만, 자신 이외의 살마들은 믿고 있음에 틀림없다.'고 많은 사람들이 생각하게 된다.

심리학에서는 이런 상태를 '다원적 무지'라고 한다. 이런 상태가 되면, 헛소문을 믿는 사람이 화장지를 사려고 서두르면 헛소문을 믿지 않는 자신도 피해를 보게 되는 사러 가는 행동을 취하는 사람이 늘어난다. 결국 이렇게 해서 많은 사람이 헛소문의 내용을 믿지 않았음에도 불구하고 헛소문은 현실이 된다. 객관적인 사실을 전달하려는 매스미디어에 비해, SNS는 주관적인 체험과 감정을 급속하게 퍼뜨리기 쉽다. 코로나 19시대를 겪으면서 각국에서 일어난 화장지 품귀 소동은 SNS가 일으켰다고도 말할 수 있다.

3. 확산되는 화제에 이끌리는 심리

실제로 '좋아요'를 받고 싶어 다양한 정보를 올리는 사람도 있는 반면, 자신의 글은 거의 올리지 않은 채 오로지 정보 수집을 위해 SNS를 이용하는 사람도 있다. SNS 상에서의 행동 이면에 있는 심리를 일반화하기는 어렵지만 몇 가지 심리 효과가 있음을 지적할 수 있다.

우선 SNS에는 사람의 욕구를 충족시키는 기능이 있다고 생각된다. 미국의 심리학자 '에이브러햄 매슬로(Abraham Harold Maslow, 1908~1970)'에 따르면 사람의 욕구는 '생리적 욕구', '안전에 대한 욕구', '소속과 사랑의 욕구', '존경의 욕구', '자아실현의 욕구'의 5단계설로 나눌 수 있다고 한다. 타자와 다양하게 연결될 수 있는 SNS는 '소속과 사랑의 욕구'를 충족시킬 수 있으며, 또 자신이 올린 글에 '좋아요'가 붙거나 글이 널리 퍼져 많은 사람에게 읽힘으로써 '존경의 욕구'도 충족된다. 이런 욕구를 충족시킬 수 있는 것이, 사람들이 SNS를 이용하는 동기의 하나라고 생각된다.

3-1. 밴드웨건 효과

SNS에서 정보가 급속히 확산할 때는 '밴드웨건 효과'가 작용한다고 한다. '밴드웨건 효과(Bandwagon Effect)'는 많은 사람의 지지를 받는 것에 끌리는 심리적 경향으로, 미국의 경제학자 '하비 라이벤스타인(Harvey Leibenstein, 1922~1994)'이 제창했다. '밴드웨건'이란 행진 선두에 있는 악대가 탄 자동차나 마차를 가리킨다.

사람들이 줄을 서서 들어가려고 기다리는 가게를 보면, 사람은 그 가게에 대해 잘 모르더라도 '아주 좋은 가게일 거야'라고 생각해버리는 경향이 있다. 트위터에 있는 정보가 급속히 리트윗되는 것을 보았을 떄도 그 정보의 가치르를 스스로 확인하지도 않은 채 '모두가 퍼뜨리고 있다면 퍼뜨릴 만한 가치가 있는 정보일 거야'라고 생각해 자신도 바로 리트윗하는 행동을 취하는 경우가 있다. 원래의 글이 팔로워의 수가 많은 인플루언서가 발언·확산시킨 것이라면 더 말할 나위가 없다. 이것은 '밴드웨건 효과'가 작용하고 있다고 말할 수 있다.

3-2. 에코 쳄버 현상

SNS에서는 자신과 흥미와 관심이 비슷한 사람들이 연결되는 경우가 많다. 그와 같은 SNS 상에서의 연결을 통해 자신에게 들어오는 의견과 감상은 자연히 자신의 생각과 비슷한 것뿐이다. 그러면 자신의 생각이 세상에서 일반적이라고 믿기 쉬워진다. 이것은 '에코 쳄버(Echo Chamber)' 현상으로 알려져 있다. '에코(Echo)'는 '메아리를 뜻하고, '챔버(Chamber)'는 방을 의미하는 영어이다. '에코 챔버 현상'이 일어남으로써 SNS의 집단 안에서 편향된 의견이 확산될 가능성이 있다. 그 결과 자신과 타인의 생명과 관련된 편향된 위기 정보를 자신도 모르는 사이에 퍼뜨릴 위험도 있다. 이런 현상이 존재한다는 점을 인식해, SNS 이외의 정보원을 확인하는 등의 주의가 필요하다.

4. 가짜뉴스의 패턴

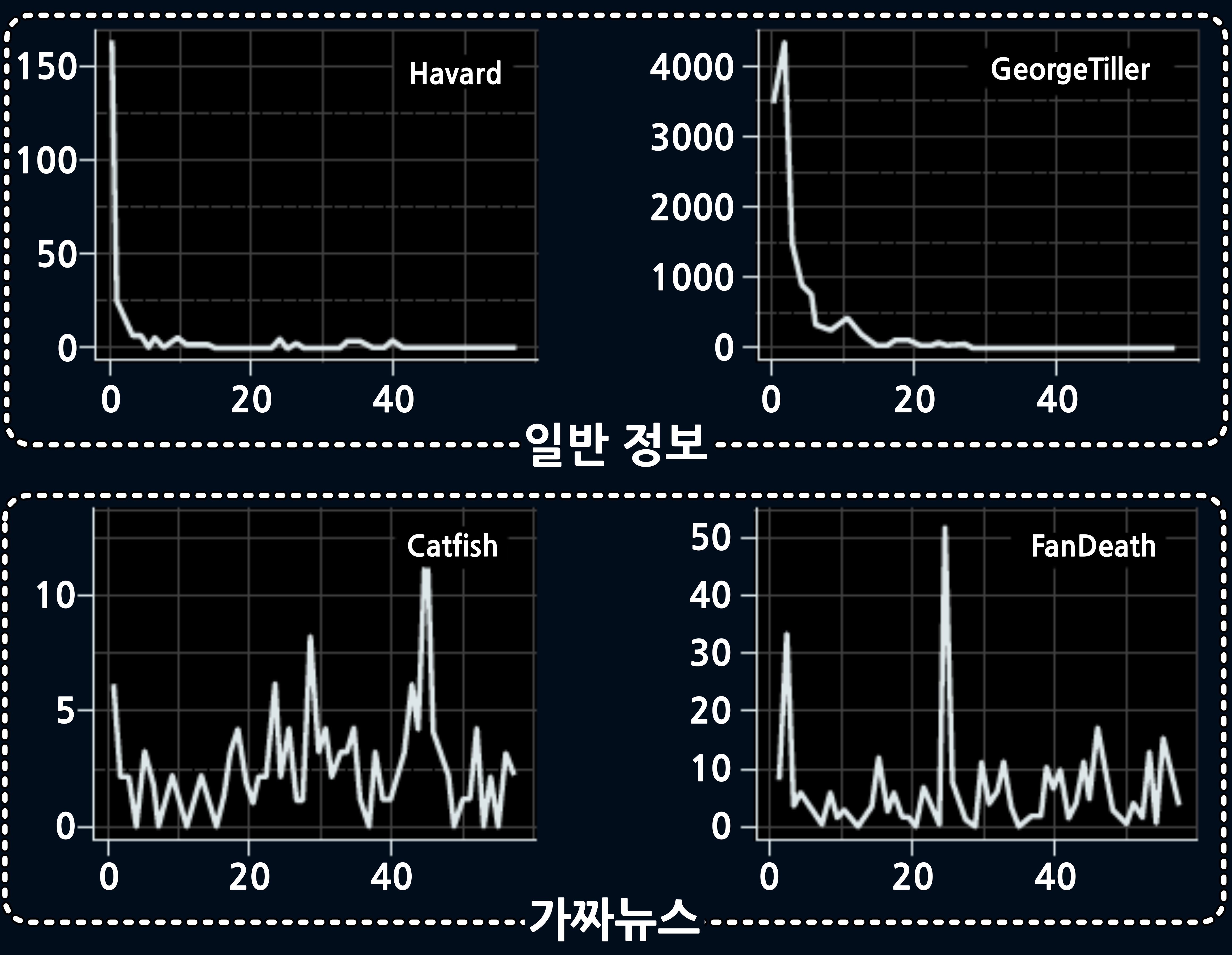

소셜미디어 사용자는 개별 메시지의 진위성을 판단하기 쉽지 않다. 하지만 메시지가 네트워크를 통해 확산되는 패턴을 보면, 일반 정보와는 다른 가짜뉴스의 특징이 분명하게 드러난다. 카이스트 전산학과의 '차미영' 교수 연구진과 서울대학교 '정교민' 교수 연구진은 세계 5000만 트위터 사용자가 생산한 20억 개의 메시지와 20억 개 팔로우 링크를 분석하여 가짜뉴스의 전파 특성을 찾았다. 분석에는 해외 루머를 수집해놓은 '스놉스닷컴(snops.com)'자료가 활용되었다. 빅데이터는 '가짜뉴스'와 '일반 정보'가 전파되는 몇 가지 패턴에 차이가 있음을 보여주었다.

4-1. 끊임없이 재생산되었다.

우선 '가짜뉴스'와 '일반 정보'는 '전파 주기'에 차이가 있었다. '일반 정보'는 일단 전파된 후, 대중의 관심에서 멀어지면 사라지는 명확한 사이클을 보였다. 반면 '가짜뉴스'는 끊임없이 재생산되며 정보의 전파가 몇 주나 몇 달, 길게는 수년 동안 지속되는 패턴을 보였다. 대표적인 예로 2008년 미국 대선에 시작된 '오바마는 무슬림이다.'라는 루머는 10년이 넘게 언급되었다. 이런 패턴은 전파자의 목적을 위해 가짜뉴스가 계획적으로 확산되기 때문에 나타나는 것으로 생각된다.

4-2. 임의 수용자를 통해 전파되었다.

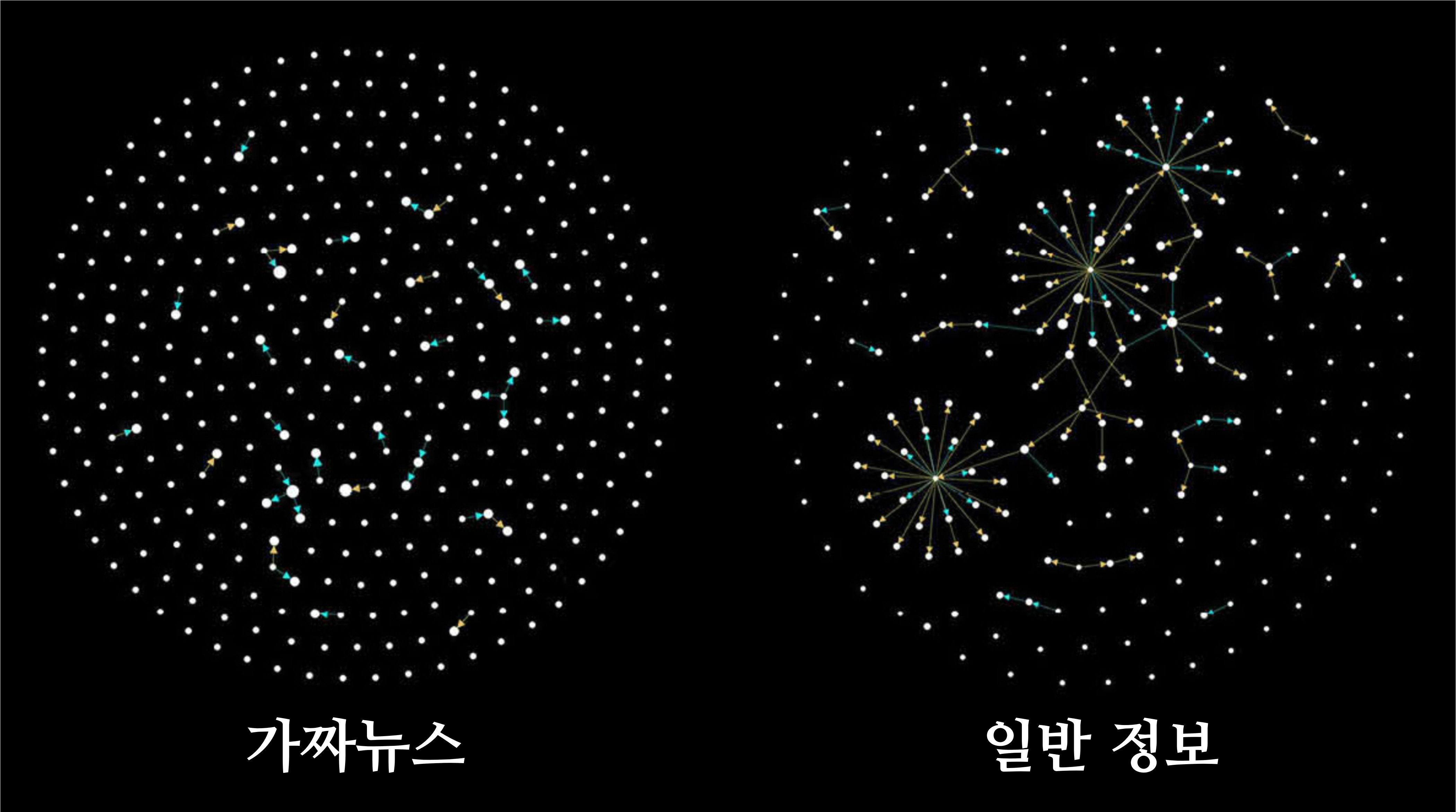

다음으로 가짜뉴스는 임의 수용자를 통해 전파되는 특징을 보였다. 아래의 그림을 보면, '일반 정보'는 '팔로워 네트워크(Follower Network)'를 통해 전파되고 있음을 유추할 수 있는 반면, 가짜뉴스는 서로 연결되지 않은 개인의 참여로 전파가 이루어진다는 것을 알 수 있다. 그 결과 가짜뉴스는 매우 매우 산발적이고 작은 점조직처럼 전파되는 형태를 나타냈다. 또 '가짜뉴스'는 '일반 정보'와는 반대로 팔로워가 적은 사용자에서 팔로워가 많은 사용자로 전파되는 경우가 많았다. 이는 그동안 쌓은 신뢰를 잃을 위험이 있어, 인플루언서가 의심스러운 정보의 초기 전파에 참여하기를 주저하기 때문인 것으로 보인다. 이를 통해 볼 때, 뉴스의 초기 전파에 참여하는 사용자 정보는 정보의 진위를 가르는 데에 중요한 힌트를 제공한다. 아래의 그림에서 점은 트위터 사용자를 의미하고, 점들을 연결하는 선은 '리트윗(Retweet)' 혹은 '메세지의 멘션 관계'를 의미한다.

4-3. 전파 속도가 빨랐다.

2018년, '사이언스(Science)'에 실린 MIT 연구팀의 결과에 따르면, '가짜뉴스'와 '일반 정보'는 확산 속도에서도 차이를 보였다. 놀랍게도 가짜뉴스의 온라인 확산 속도는 사실을 다룬 뉴스보다 평균 6배가 빨랐다. 트위터 수용자 1500명을 기준으로 뉴스가 도달하는 시간을 측정한 결과, 가짜뉴스는 평균 10시간이 걸린 반면, '일반 정보'는 60시간이 걸리는 것으로 확인됐다. 그중에는 '일반 정보'보다 20배 빨리 퍼진 '가짜뉴스'도 존재했다. 특히 정치와 관련된 가짜뉴스는 다른 주제에 비해 빠른 전파력을 보였다. 또한 트위터에서 가짜뉴스는 4만 5000회 이상 리트윗된 경우가 있었지만, '일반 정보'가 1000회 이상 리트윗된 사례는 많지 않았다.

더불어 이 연구는 누가 가짜뉴스의 확산에 참여하는지를 보여주었다. 가짜뉴스의 빠른 전파력이 특정 목적으로 개발된 프로그램을 사용하여 자동으로 트윗을 작성하는 '봇(bot)' 때문일 거라는 일반적인 생각과는 달리, 봇은 가짜뉴스 확산의 주요 매개체는 아닌 것으로 조사되었다. 이는 특히 2016년 미국 대선에 관련된 가짜뉴스 확산의 주범으로 봇이 지목되어온 것과는 상반된 결과였다. 연구진은 가짜뉴스 확산의 주범이 소셜미디어 사용자라고 밝혔고, 그 주요 기저에는 새로운 정보를 검증 없이 빠르게 소비하기 좋아하는 인간의 심리가 있다고 해석했다.

5. 가짜뉴스 확산에 대처하는 두 가지 접근법

위에서 말한 '플랫폼의 특성'과 '사용자의 특성'에 근거해, 각기 다른 가짜뉴스 대처 방법이 제시되었다.

5-1. 플랫폼 접근법

콘텐츠를 정렬해서 보여주는 플랫폼 회사들은 가짜뉴스의 가능성이 있는 기사의 순위를 낮추거나 삭제함으로써, 사용자 화면에서 검색이 되지 않도록 막을 수 있다. 플랫폼의 노력은 크게 '페이스북(FaceBook)'과 '구글(Google)'의 스타일을 살펴볼 필요가 있다. 먼저 페이스북의 경우는 2016년부터 '삭제'(Remove)', '축소(Reduce)', '안내(Inform)'라고 부르는 일련의 전략을 제시한다. 먼저 '사용자의 신고'나 '내부 알고리즘'에 의해 커뮤니티 규정을 위반했다고 판단되는 콘텐츠는 바로 삭제한다. 유해 콘텐츠를 퍼트리는 수백만의 거짓 계정과 봇의 제거도 여기에 해당한다. 다음으로 커뮤니티 표준을 위반하지는 않지만 문제가 있는 콘텐츠일 경우에는 랭킹 결과를 조정해 확산 범위를 대거 축소한다. 더불어 페이스북은 가짜뉴스로 판정된 데이터를 인공지능으로 학습하여, 콘텐츠의 패턴을 확인한 후 향후 발생한 유해 콘텐츠를 예측한다. 그리고 그 예측 결과를 외부 '팩트체크(Fact Check)' 기관에게 전달하여 콘텐츠를 검토한다. 거짓으로 확인된 정보는 피드에 표시될 확률이 낮아지게 되며, 이러한 라벨링 데이터가 쌓일수록 머신러닝의 성능은 더욱 정교해진다.

마지막으로 뉴스피드에 나오는 콘텐츠에 맥락에 대한 추가 정보를 기사와 함께 제공해, 사용자 스스로 사실 여부를 판단하도록 '안내'해준다. 예컨대 기사의 하단에 위키피디아의 정보나 외부 팩트체크 기관의 라벨을 표시하는 것이다. 구글도 마찬가지로 검색한 기사에 팩트체크 결과를 태그로 표시하는데, 이러한 라벨은 외부 기관에 의해 제공된다. 단 모든 검색에 적용되는 것은 아니며, 가짜뉴스의 논란이 있는 주제에 한해 제공된다.

- 신뢰 프로젝트(Trust Project): 이러한 노력의 대표적 사례로 '구글(Google)', '페이스북(FaceBook)', '트위터(Twitter)' 등 거대 온라인 플랫폼이 함께 참여해 가짜뉴스와의 전쟁을 선포한 '신뢰 프로젝트(Trust Project)'를 들 수 있다. 산타클라라 대학교(Santa Clara University)'의 마쿨라응용윤리연구소 저널리즘 윤리 프로그램 책임자 '샐리 리먼(Sally Lehrman)'은 전 세계 뉴스 리더를 초청하여, 사람들의 요구를 충족시키는 디지털 표준인 '신뢰 지표(Trust Indicator)'를 구축했다. '신뢰 지표'에는 '뉴스 조직의 윤리', 명확성', '공정성', '정확성', '언론인의 배경' 등이 포함된다. 이는 플랫폼 사용자에게 기사의 배경 정보를 충분하게 제공함으로써, 사용자들 스스로 해당 기사가 신뢰할 수 있는지를 판단할 수 있도록 도와준다.

- 크로스 체크(Cross Check): 또 플랫폼이 참여한 대대적인 노력으로 2017년 프랑스 대선 기간 동안 가짜뉴스를 선별하는 '크로스 체크(Cross Check)'라는 협업 저널리즘 프로젝트가 있다. 이 프로젝트에는 수많은 언론사가 파트너로 참여했으며, 미디어 및 기술 업계의 전문 지식을 결합하여 '가짜뉴스', '소문', '허위 주장'이 신속하게 철회되고 정확하게 보도되도록 했다. '구글 트렌드(Google Trends)'는 전국 각지에서 실시간으로 후보자 및 캠페인 주장에 대한 검색 결과를 제공했으며, 다양한 도구와 기술 플랫폼을 사용하여 가짜뉴스를 선별했다. 대중이 분쟁 사이트 및 소셜 콘텐츠에 대한 정보를 '크로스체크(Cross Check)'에 제보하도록 권장했고, 이를 여러 언론사가 검증하여 사실 여부를 판단했다.

'틱톡(Tik Tok)'은 중국의 기업 '바이트 댄스(Byte Dance)'에서 운영하는 서비스로, 짧은 영상을 공유할 수 있는 소셜미디어이다. '틱톡'은 특히 청소년층에서 특히 선풍적인 인기를 끌고 있다. 이 앱은 콘텐츠 큐레이션에 있어 기존 미디어와는 차별화된 방식을 도입했다. 틱톡은 유튜브처럼 여러 영상을 추천하지 않고, AI 기술을 사용해 애초에 사용자에게 보여지는 동영상을 결정한다. 사용자의 앱 내 활동 로그를 바탕으로, 다음에 하나씩 보여질 동영상을 AI가 자동적으로 계산하는 것이다. 물론 이런 방식은 플랫폼이 정보를 검열하고 표현의 자유를 제한한다는 평가도 있긴 하다. 하지만 플랫폼이 콘텐츠 랭킹을 완전히 결정하므로, 기존의 플랫폼에서 나타난 가짜뉴스나 부적절한 콘텐츠의 확산과 같은 부작용이 아직 나오지 않고 있어 새롭게 평가되고 있다.

5-2. 사용자 특성 접근법

'사용자 특성 접근법'은 미디어 콘텐츠 사용자가 일반적으로 가짜뉴스를 대하는 태도와 자세를 연구하여, 이를 바탕으로 보다 효율적으로 가짜뉴스의 전파 및 확산을 막으려는 접근법이다.

'사용자 특성 접근법' 관련해서는 인공지능에 기반한 다양한 시도가 이루어지고 있다. 예컨대 2019년 서울대학교 연구팀은 '낚시성 기사'를 검출할 수 있는 모델을 개발했다. 이 모델은 딥러닝 학습 모델인 '순환 신경망(RNN: Recurrent Neural Network)' 계열의 LSTM을 사용하여, 기사 내부 정보만으로 내용이 일관성을 갖는지 파악한다. 또 문단 구조와 단어 나열에 따른 의미를 이해해, 제목과의 관계를 파악한다. 딥러닝 모델 중 RNN 계열은, 정보를 처리할 때 이전 단계를 기억해서 다음 과정에 활용하는 것이 특징이다. 단어들이 모여 의미를 갖는 텍스트 분석에 능하다고 할 수 있다. 특히 특정 벡터에 주목하게 만들어 성능을 개선시키는 '어텐션 기법(Attention Mechanism)'이 적용되어 기사 전체의 낚시성뿐만 아니라, 본문에서 어느 문장이 근거로 활용되는지를 판단하였다. 개발된 모델에 200만 건에 이르는 온라인 기사로 훈련 데이터 세트를 만들어 학습한 결과, 모델의 정확도는 90%가 넘었다. 외부 정보 없이 이 모델만으로 전체 기사에서 낚시성의 기사 대부분을 찾아낼 수 있기 때문에, 향후 포털이나 검색 사이트 내 자동 기사 분석 부가 서비스로 활용될 수도 있을 것이다.

그 밖에 '카이스트(KAIST)'의 오혜연 교수팀은 '가짜뉴스 콘텐츠 자체의 특성'보다는 '가짜뉴스 관련 사용자들의 신고 패턴'을 확률적으로 모델링하여 '커브(CURB)'라는 알고리즘을 개발하는 데 성공하였다. 이 연구는 '확률적 최적 조절법' 등의 수학적 기법을 활용해, 접수되는 네티즌들의 집단 신고가 어느 수준까지 도달했을 때, 알고리즘이 행동에 나설지에 대한 기준을 세운 것이다. 예컨대 외부 전문 기관에 해당 정보의 진위 여부 판별을 언제 의뢰할지 등에 대한 기준을 세운 것이다. 이 알고리즘은 특히 가장 단기간에 가짜뉴스를 적발할 수 있는 '골든타임(Golden Time)'을 포착하도록 설계됐다는 데 의의가 있다. 연구진들은 해당 알고리즘에 영문판 '트위터(Twitter)'와 중국 '웨이보'의 데이터를 활용해 실제 실험을 결과, 최적의 시기에 가짜 정보를 검출해 내는 효과가 있었다. 이에 따라 적기에 해당 가짜뉴스를 제3의 팩트체크 기관에 넘길 수 있었다.

이외에도 언론학자와 사회심리학자를 중심으로 '가짜뉴스를 접한 사람들의 잘못된 인식을 팩트체크를 통해 교정하는 방법'에 대해서도 활발히 연구가 진행되고 있다. 그 대표적 사례로 한국언론진흥재단 연구진이 2018년 실험 연구 기법을 이용하여, 19대 대선 기간 후보자 상호관에 제기된 의혹에 대해 팩트체크 효과를 연구했다. 연구 결과, 미디어 이용자는 지지 후보와 상관없이 팩트 체크 결과를 신뢰한다는 것을 알 수 있었다. 그리고 컬럼비아대학교 경영대 연구진들은 설문 조사를 통해, '사실 여부가 의심되는 어떤 주장을 다른 사람들이 동시에 팩트체크하고 있음을 알고 있는 사람'은 해당 주장에 대해 팩트체크하지 않으려는 경향을 보인다는 점을 밝혀냈다. 이 발견은 향후 소셜미디어 플랫폼 내에서 팩트체크 관련 정보를 보여주는 방식을 결정하는 데 도움을 줄 수 있을 것이다.

6. 각국의 가짜뉴스 대응 사례

가짜뉴스가 사회에 미치는 영향에 대한 우려가 확산되면서, 각국의 대응 사례에 대해서도 관심이 집중되고 있다.

6-1. '독일'의 가짜뉴스 대응 사례

- 요약: 네트워크 집행법

2017년 2일 7일, 독일 남부 바이에른주 뷔르츠부르크 법원에서 페이스북을 상대로 한 재판이 있었다. '앙겔라 메르켈(Angela Merkel)' 독일 총리와 찍은 사진이 조작되면서 테러리스트로 몰린 시리아 난민 청년 '아나스 모다마니(Anas Modamani)'가 아일랜드에 본부를 둔 페이스북 유럽법인을 상대로 조작 게시물 삭제 소송을 낸 것이다. 하지만 뷔르츠부르크 법원은 '페이스북이 신고받은 게시물을 제외하고, 그 외의 것까지 삭제할 의무는 없다.'라고 판시했다.

이 사건 이후 독일은 좀 더 가짜뉴스에 강화된 입장을 보이며, 2018년 1월부터 '네트워크 집행법(Network Enforcement Act)'를 시행하고 적극적인 규제에 나섰다. 이 법안은 독일 내 소셜미디어 기업이 사용자가 불법에 해당하는 게시물을 신고할 경우, 24시간 이내에 게시물을 삭제해야 하며 판단이 어려울 경우 7일 내에 불법성 여부를 판단 후 삭제 또는 차단을 해야 한다는 내용이다. 불법에 해당하는 게시물은 '테러 선동', '범죄단체의 모집', '신앙이나 종교집단에 대한 비방', '아동 포르노'등 총 21개로 정해졌다. 이를 위반할 경우, 해당 기업은 5000만 유로의 벌금이 부과될 수 있다. 또한 소셜미디어 기업은 분기별로 관련 보고서를 작성해서 보고해야 한다. 이 법안이 시행된 이후, 과도한 검열로 표현의 자유가 침해될 수 있다는 우려가 제기되었다.

6-2. '프랑스'의 가짜뉴스 대응 사례

- 요약: 정보조작 대처법

2018년 초에 프랑스의 '엠마뉘엘 마크롱(Emmanuel Macron)' 대통령은 가짜뉴스의 위험성을 우려하며, 이에 대항하여 민주주의를 보호할 수 있는 법안을 추진하겠다고 선포하였다. 2017년 대선 기간 동안, 그는 '해외 비밀계좌 보유설', '동성애자설' 등 오해의 소지가 있는 주장이나 비방에 시달렸다. 이에 프랑스는 2018년 11월에 '정보 조작 대처법(Les propositions deloi contre la manipulation de l'information)'을 통과시켰다. '정보 조작 대처법'은 선거 3개월 전부터 선거 당일까지 생산되는 가짜뉴스에 대한 확산을 저지하는 것을 목표로 하며, 허위 정보의 배포를 판사가 중지시키도록 하고 있다. (48시간 이내에 파악 후 명령)

독특한 부분은 이 법안이 선거 기간 동안 외국의 영향 아래 있는 미디어오 협약을 중단한다는 내용이다. 즉, 선거 기간 동안 외국 언론이나 정치세력이 들어와서, 여론을 교란하는 행동을 좌시하지 않겠다는 것이다. 프랑스는 '시청각 감독 위원회'와의 협력을 통해, 외국의 통제에 있는 서비스가 허위 정보를 유포하여 국가의 기본 이익을 해친다면, 그 국가의 영향 아래 통제되는 방송 서비스에 대해 방송 중지 명령을 내릴 수 있도록 했다. 다만, 이 법안을 통해 표현을 통해 표현의 자유가 위협받을 가능성이 있고, 판사가 허위 정보를 파악하고 검증하기에 시간이 충분하지 않다는 문제가 제기되고 있다.

6-3. '미국'의 가짜뉴스 대응 사례

- 요약: 표현의 자유를 중시하다.

미국 최대 규모의 트래픽을 자랑하는 '버즈피드 뉴스(Buzzfeed News)'에서는 '미국 제45대 대통령 선거(미국 2016년 대통령 선거)' 시 페이스북 데이터를 분석하였다. 그 결과, 선거 기간 동안 급속히 확산된 가짜뉴스에 대한 반응 수가 871만여 건으로 주류 언론사보다 높았다. (여기에서 반응 수는 공유와 댓글의 수를 말함) 또한 반응이 가장 좋았던 10개의 기사 중 상위 5개의 기사가 가짜뉴스였음을 확인하였다. 그중 가장 많이 공유된 기사는 '프란치스코 교황이 도널드 트럼프 후보를 지지했다.'는 제목의 가짜뉴스였다. 가짜뉴스로 대선의 판도가 바뀌었다는 주장까지도 나왔다.

이에 대한 법적 대응은 어땠을까? 미국은 유럽의 국가들과 비교했을 때, 법적·제도적 대응이 약한 편이다. 미국 45대 대선 이후 2017년 3월에 가짜뉴스를 합법적으로 제한하기 위한 '검열 법안'아 제시되었다. 그러나 표현의 자유를 억압한다는 이유로 이 법안은 부정적인 평을 얻었다. 미국에서 법적으로 소셜미디어 기업을 제재하기 어려운 이유는 1996년에 제정된 '사이트 운영자는 사용자가 올린 콘텐츠에 대해서 책임을 지지 않는다.'라는 '통신품위법(The Communication Decency Act)' 제230조 법안 때문이다. 단, 2018년 4월에 통과된 '온라인 성매매와의 전쟁법(FOSTA: Fight Online Sex Trafficking Act)' 법안으로 성매매를 방조하는 가짜 콘텐츠의 경우는, 특별히 사이트 운영자에게 민형사상 책임을 물을 수 있게 되었다.

7. 가짜뉴스의 미래

2017년에 워싱턴대학교 연구팀은 '생성적 적대 네트워크(GAN: Generative Adversarial Networks)'라는 기술을 활용하여, 오바마 전 미국 대통령의 가짜 연설 영상을 만들어냈다. '이언 굿펠로(Ian Goodfellow)'가 제안한 GAN 모델은 진짜 같은 가짜 영상을 만들어내는 '생성자 인공지능(Generator AI)'과 이 영상이 진짜인지 가짜인지를 판별하는 '구분자 인공지능(Discriminator AI)'를 서로 경쟁시켜 서로의 성능을 개선해 나가는 모델이다. 지폐 위조범이 최선을 다해 위조지폐를 만들고 경찰은 위조지폐를 감별하기 위해 노력하듯이, 경쟁 구도를 가지는 2개의 인공지능은 결과적으로 가짜 영상의 완성도를 높여 진짜와 가짜의 구분을 어렵게 만든다.

가짜 데이터를 만들어내는 기술은 나날이 발전해 나가고 있다. 현재는 우리가 원하는 대로 이미지를 바꾸어 재생성하는 것이 가능해졌으며, GAN 기술은 이미지, 영성, 음성신호, 자연어 처리 등으로 영역이 확대되고 있다. 이제 눈앞에 보이는 것이 진실이라는 말은 믿을 수 없는 말이 되고 있다.

가짜뉴스의 무분별한 유포를 완전히 차단하는 일은 현실적으로 불가능에 가깝다. 미래에는 가짜 콘텐츠 제작 능력이 진짜와 가짜를 구분하는 능력을 능가하게 되어, 결국 콘텐츠에 대한 신뢰감이 하락해 오해와 불신을 조장하게 될 가능성이 크다. 따라서 플랫폼들의 다양한 기술적 노력 외에도, 정보 소비자들은 진실과 거짓이 공존하는 온라인 미디어에서 날카로운 눈으로 정보를 검증하는 능력이 필요하다. 또 가짜뉴스를 빠르게 종결시키고 질서와 조화를 이루기 위해서는 사법부의 역할이 핵심적이다. 가짜뉴스의 개별적 사례에 대응하기보다는, 먼저 우리 사회에 맞는 법과 제도를 마련하여 가짜뉴스에 어떻게 대응할 것인지 사회적 합의가 필요하다.